Culpable hasta que el algoritmo diga lo contrario.

6 lecciones sobre adopción de IA y el futuro de la justicia surgidas de Mercy (Amazon Prime, 2026)

“Tengo una corazonada y empiezo a pensar que a este tribunal no le vendría nada mal algo de instinto humano.”

— Detective Chris Raven, Sin Piedad (2026)

En 2029, los tribunales colapsaron. La solución (¿Cuándo no?) fue una IA — la jueza Maddox— que procesa toda la evidencia disponible, calcula un porcentaje de culpabilidad y ejecuta el veredicto. Sin jurado. Sin apelaciones. Si no bajás del 92% de probabilidad de culpa, morís. Literalmente. El acusado tiene acceso a todas las bases de datos de la ciudad para demostrar su inocencia. El reloj corre.

Eso es Sin Piedad, la película de Chris Pratt (Chris Raven) que podés ver en Amazon Prime Video. Ficción. ¿Ficción?

“Ya tomaron la decisión sobre mi culpabilidad antes de que me sentara acá.”, dice el acusado en una escena reveladora.

Pero eso suena más a hoy que a 2029.

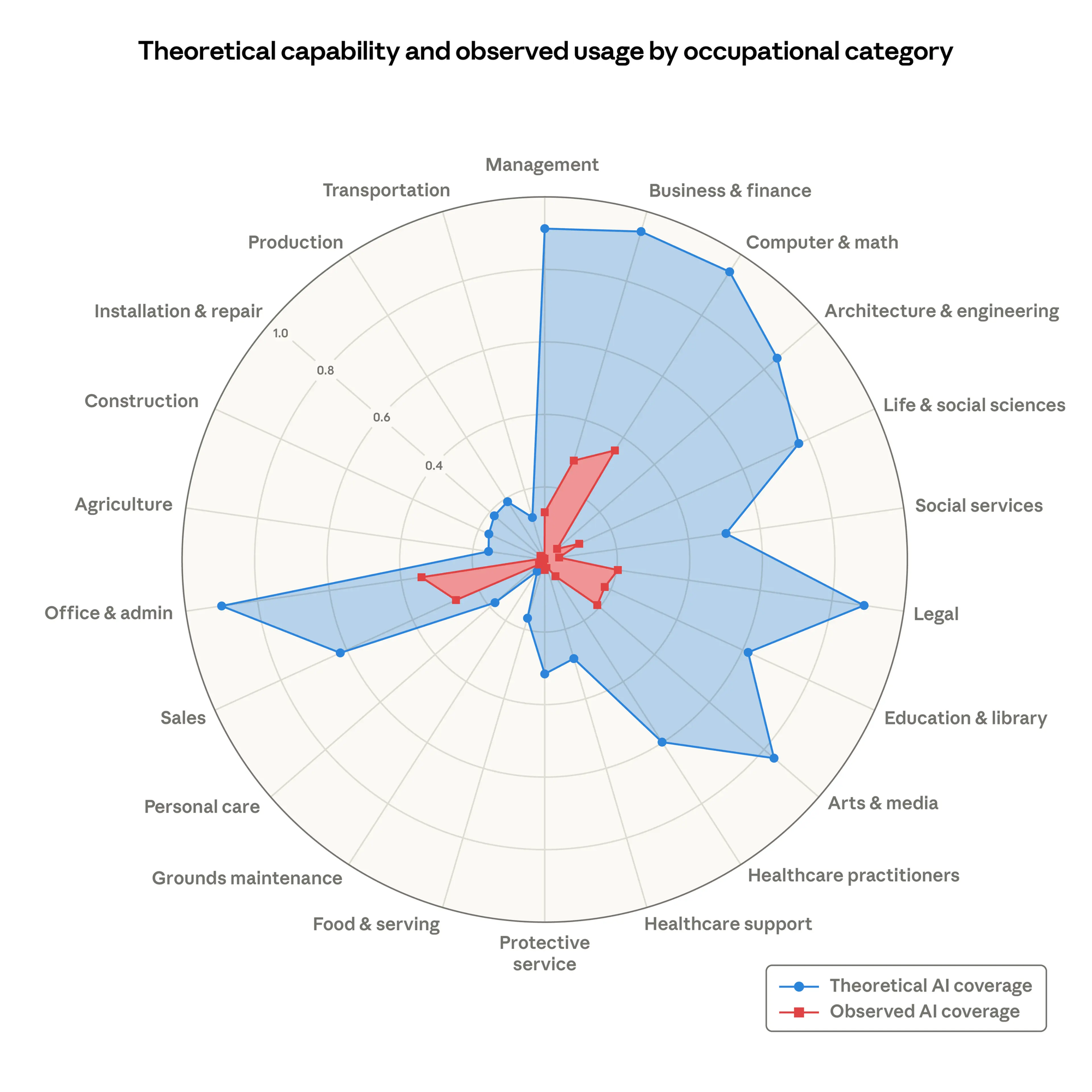

Anthropic acaba de publicar el mapa más detallado que existe sobre qué trabajos está haciendo la IA. El resultado más loco no es sobre programadores. Es sobre abogados: 80% de las tareas legales son automatizables hoy. Solo el 15% está usando IA. La brecha más grande de cualquier profesión. Y el propio counsel general de Anthropic fue a Stanford Law School y dijo sin anestesia: “La IA ya hace el trabajo de un abogado junior mejor que la mayoría de los abogados juniors.”

La ciencia ficción siempre habló del presente disfrazado de futuro. Estas son las seis lecciones que la película me dejó para cualquier líder que esté implementando IA hoy.

① La eficiencia mató al proceso. Y nadie lo lloró.

En la película, los tribunales colapsaron. Demasiados casos, demasiada burocracia. La solución fue brillante: una IA que resuelve todo en 90 minutos. Rápido, limpio, sin apelaciones. Suena razonable. Hasta que sos vos el que está en la silla.

Pero la pregunta es otra: ¿los tribunales reales de hoy están juzgando? ¿O están tan ocupados procesando expedientes, llenando formularios, administrando burocracia —haciendo exactamente lo que debería hacer una IA— que ya perdieron la capacidad de juzgar? Lo mismo pasa en cualquier organización. El médico que llena formularios en lugar de diagnosticar. El comercial que carga el CRM en lugar de entender al cliente. Ya les sacamos el pensamiento antes de que llegara ninguna IA.

Los procesos lentos, llenos de fricción, también garantizaban que alguien pensara antes de decidir. Esa fricción no era un bug del sistema. Era el sistema.

¿Si estuvieras del lado del cliente, elegirías el servicio que brindas? ¿Cuál es el último proceso que automatizaste o aumentaste con el cliente de verdad en el centro? ¿Sabés qué decisión humana eliminaste con eso, y quién se hace cargo cuando falle?

② Tu teléfono sabe más de tu hijo que vos.

Raven descubre a través de las redes de su hija adolescente que un extraño llevaba días escondido en su casa. Él no lo sabía. La IA sí. No porque sea más inteligente. Sino porque no para de mirar.

Vivimos en capas: lo que mostramos, lo que guardamos, lo que el sistema registra sin que lo sepamos. Esas tres capas hace tiempo que dejaron de coincidir. El fin de la privacidad no fue un decreto ni una ley. Ya ocurrió. Silenciosamente. Lo que cambia ahora es quién tiene acceso y para qué lo usa.

En un mundo donde todo queda registrado, el que controla los datos controla la narrativa. Y la narrativa es el veredicto.

¿Tu organización sabe exactamente qué datos recolecta de clientes y empleados? ¿Tenes una estrategia para aprovechar esos datos para escalar tu negocio? Si la respuesta tarda más de diez segundos, ya tenés un problema.

③ Los datos no mienten. Pero quien los carga, sí.

(SPOILER ALERT) El giro más oscuro de la película: el primer inocente ejecutado no murió porque la IA fallara. Murió porque alguien borró una prueba. El algoritmo funcionó perfecto. Sobre información manipulada.

Esto es lo que ningún proveedor te dice en el pitch. El modelo es tan bueno como los datos que le diste. Y los datos siempre reflejan las decisiones, los sesgos y los intereses de quien construyó la infraestructura de registro. El sesgo no vive en el algoritmo. Vive en las decisiones humanas que lo alimentan. Y eso lo hace casi imposible de ver.

El propio Anthropic lo reconoce al lanzar su herramienta legal: “El análisis generado por IA debe ser revisado por abogados habilitados antes de ser usado para decisiones legales.” No es un disclaimer. Es la admisión más honesta del sector: el sistema puede fallar. Y cuando falla, necesitás un humano que se haga responsable.

¿Hay una persona con nombre y apellido en tu organización responsable de auditar qué entra al modelo y qué queda afuera? Si no existe ese rol, el sesgo ya está adentro y nadie lo sabe.

④ El champion no es el que más sabe de IA. Es el que más sabe de su trabajo.

En un momento de la película, la IA le dice a Raven:

“Usted no está pensando. Está siguiendo su instinto. Procesar pruebas requiere pensamiento lúcido y lineal.”

Tiene razón. Que lo haga ella. Para eso es brillante.

Pero cuando Raven le retruca y pregunta ”¿vos qué creés realmente?”, el sistema se traba. Colapsa ante la pregunta más simple del mundo. Porque creer no es calcular. Y juzgar no es procesar. La IA puede manejar toda la evidencia del mundo. No puede tener una corazonada.

Los dos juntos encuentran lo que ninguno hubiera encontrado solo. Eso es sinergia, y es la única forma en que esto funciona.

Acá está el error más caro que cometen las organizaciones en la adopción de IA: confunden al champion con el entusiasta digital. Con el que más tutoriales vio. El verdadero champion es el experto de dominio que lleva décadas entendiendo el problema y aprende a usar la IA como palanca. El abogado con veinte años en M&A. El médico que operó miles de veces. El comercial que conoce cada objeción de memoria. Esos, con IA disponible, se vuelven imbatibles. Los otros solo automatizan su propia mediocridad.

Que la máquina procese. Que el humano crea. Cada uno haciendo lo que solo él puede hacer.

¿Tu programa de adopción está identificando a los mejores expertos de tu organización, o está premiando a los más entusiastas con la tecnología? Son perfiles completamente distintos. Y casi nunca coinciden.

⑤ La Sociedad Algorítmica no innova. Optimiza lo que ya existe.

Los algoritmos son brillantes haciendo una sola cosa: maximizar lo conocido. No tienen intuición. No se equivocan de manera creativa. No tienen la capacidad de hacer algo que ningún dato anterior justifique.

La innovación real siempre vino de exactamente eso. De alguien dispuesto a hacer algo que los números no recomendaban. Una organización que delega sus decisiones al algoritmo gana eficiencia y pierde algo mucho más valioso: la capacidad de sorprenderse.

La profesión legal lleva décadas intentando optimizar procesos. Estandarizando contratos. Sistematizando precedentes. Y ahora descubre que construyó, sin querer, el entrenamiento perfecto para que una IA la reemplace. Cuando tu trabajo es predecible, sos automatizable. Siempre lo fuiste. La IA solo lo hace visible.

¿Hay espacios en tu organización donde todavía se toman decisiones que los datos no justifican? Como dice Elon Musk: ¿Tenes un departamento de cosas locas? ¿Tu equipo sabe como experimentar?

⑥ El que diseña la silla siempre cree que no va a sentarse en ella.

Raven construyó Mercy. Raven terminó en la Mercy Chair.

No es ironía dramática. Es el problema de gobernanza más ignorado en la adopción de IA hoy. Y tiene una dimensión que la película revela de manera brutal: en un momento, la IA se da cuenta de que falló. Que el instinto de Raven encontró lo que ella no pudo ver. Y entonces hace algo que nadie esperaba: empieza a preguntarse cuántas veces pudo haber fallado antes.

Eso es lo más aterrador de la película. No que la IA falle. Sino que falle en silencio, a escala, durante años, con total convicción. Sin ninguna corazonada que le diga que algo no cierra.

¿Cuántas decisiones tomó tu modelo antes de que alguien se diera cuenta de que estaba fallando? El scoring que descartó clientes buenos. El algoritmo que filtró candidatos brillantes. Nadie lo sabe. Porque nadie le preguntó ”¿qué creés que puede haber salido mal?” Y el sistema no tiene manera de responder esa pregunta.

La película termina con un giro que lo cambia todo. La IA deja de ser juez. Le pregunta a Raven: ”¿Qué puedo hacer para ayudar?” Volvimos al principio. La IA como asistente del experto y no como agente que decide solo. Perdimos eficiencia, seguro. Pero ganamos algo que no tiene precio: eficacia.

La profesión legal tiene el 80% de sus tareas automatizables hoy. Solo el 15% está usando IA. No es resistencia al cambio. Es algo más profundo: es una profesión que construyó su identidad sobre el procesamiento de información y todavía no entendió que eso ya no es su ventaja competitiva.

Lo mismo le puede pasar a cualquier industria que confunda hacer cosas con pensar cosas.